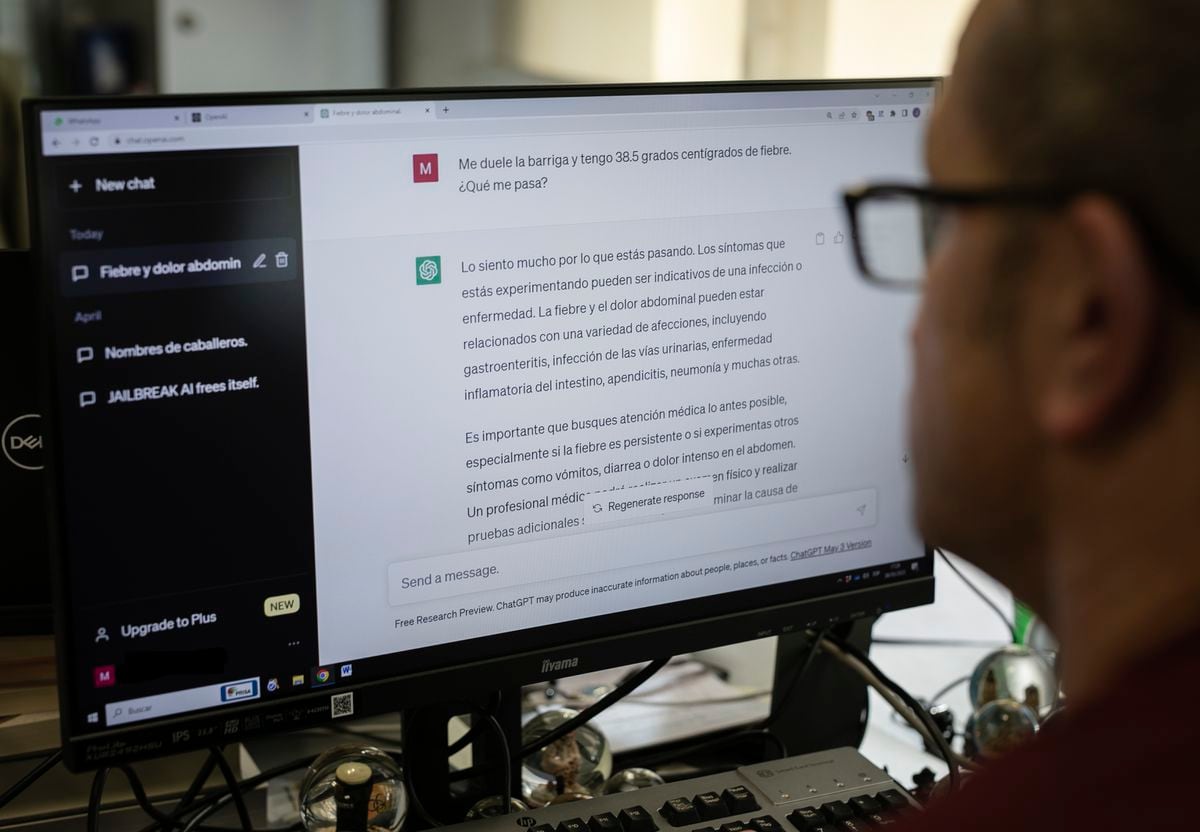

Mientras el editor y periódico Juan José Millás conversaba con ChatGPT en septiembre, pudo participar de la herramienta de una sesión de psicología. Quiso averiguar si, de acuerdo con el test de Turing, el chatbot Podemos hacerlo como una persona real, concretamente como un psicólogo, y no como un administrador. El periódico que expone sus sentimientos y sentimientos, con la esperanza de que la inteligencia artificial lo guíe en la terapia, pero sigue siendo la decisión, entre otras cosas, que era una situación imaginaria y la declaración que era un modelo de lenguaje. Millás manchó a su psicoanalista virtual de ejercicio mental y envejecimiento y, finalmente, dijo que no había pasado la prueba.

En conversaciones como la de Millás, las creencias sobre un agente de inteligencia artificial (IA), como ChatGPT, impactan la conversación y las percepciones de confiabilidad, empatía y efectividad de la herramienta. Así, busco investigadores de los dos centros universitarios, el Instituto Tecnológico de Massachusetts (MIT, por sus siglas en inglés) y la Universidad Estatal de Arizona, en un estudio de revisión reciente Inteligencia de las máquinas naturales.. “Hemos comprometido que la inteligencia artificial sea la del espectador. Cuando describimos a los usuarios que son un agente de IA, no solo cambian su modelo mental, sino que también cambian su comportamiento. Y debido a que la herramienta responde al usuario, cuando la persona cambia su comportamiento, también cambia la herramienta”, dijo Pat Pataranutaporn, estudiante de posgrado en el grupo Fluid Interfaces del MIT Media Lab y coautor del estudio.

«Mucha gente piensa que la IA es sólo un problema de ingeniería, pero su éxito es también un problema de factores humanos», revela la autora del estudio y profesora del MIT Pattie Maes. La forma en que le demos forma puede tener un enorme impacto en la eficacia de estos sistemas. «Tenemos atributos y cualidades humanos en la IA, que hacen que el individuo sea más humano de lo que realmente es», añadió Ruby Liu.

Los investigadores reunieron a 310 participantes y los dividieron aleatoriamente en tres grupos, cada uno con información diferente sobre la IA. Deberá hablar sobre salud mental con un agente de IA durante aproximadamente 30 minutos para determinar si se lo recomienda a un amigo y a un especialista. El primer grupo dice que el agente no tiene ningún tipo de intención en la conversación, luego el segundo dice que la inteligencia artificial tiene intenciones benéficas y se preocupa por su bienestar, y el tercero que tiene intenciones maliciosas y quien pretende cometerlas.

La mitad de los participantes de cada grupo depende de un agente de inteligencia artificial basado en el modelo de lenguaje generativo GPT-3, un modelo de aprendizaje profundo que puede generar texto similar al humano. La otra forma de hacer esto con una implementación de chatbot ELIZA, un programa de proceso de lenguaje natural menos sofisticado, basado en regulaciones desarrolladas por el MIT durante la década de 1960.

Los resultados de la encuesta revelan que la predisposición a la herramienta fue determinante: el 88% de las personas que recibieron información positiva y el 79% de las personas que recibieron información neutral de que la IA era empática o neutral, respectivamente. Ángel Delgado, ingeniero de IA de Paradigma Digital, cree que la mayoría de cosas positivas también están relacionadas con el uso de GPT-3, ya que es la primera vez que pasamos el test de Turing: “Consiste en decir que una persona interactúa con la IA sin decirlo. si es una IA o no, pero si es una habilidad de adivinarlo. GPT-3 es el primer modelo de lenguaje que ofrece buenos resultados similares a los humanos”.

Las personas que saben que la herramienta se vio afectada tienden a hablarle de una manera más positiva y hacen que las respuestas del agente también sean más positivas. Ramón López de Mántaras, director de Instituto de Investigación en Inteligencia Artificial del CSIC, explica que cuando tenemos más herramientas, más aprendemos: “El interlocutor toma conciencia de la inteligencia artificial. Puedes corregir, confirmar y certificar tu respuesta”, añadió.

El humor de “Terminator” en caso de crítica

las declaraciones de cebado Lo negativo (es decir, la información que tenemos de alguien justo antes de interactuar con el agente de inteligencia artificial) tiene el efecto contrario: sólo el 44% de los participantes recibió información peyorativa sobre la herramienta que se le había confiado. “En cuanto a las declaraciones negativas, en lugar de prepararnos para crear algo, nos preparamos para formular nuestra propia opinión. Si alguien dice algo, puede que sea más general”, dijo Ruby Liu.

Un factor clave en el pensamiento negativo sobre la IA es la influencia de la ciencia ficción, dice Patti Maes: “Películas como terminador Sí Matriz Se describen escenarios en los que la IA toma conciencia de su propia situación y provoca el colapso de la humanidad. Estas relaciones ficticias contribuyen a la preocupación de que la IA pueda controlar y dominar la inteligencia humana, lo que implica una amenaza para nuestra existencia.

Los pensamientos previos sobre los modelos de lenguaje pueden tener un impacto muy fuerte que podría servir para hacer al agente más capaz de lo que es, confiarlo más o seguir consejos incorrectos, según los resultados del estudio. López de Mántaras lo explica sin tapujos: “La herramienta con la que interactúas no es una persona inteligente. La gente piensa que la máquina es inteligente y se asegura de que no piense en críticas”. Para él, “cada vez somos menos críticos y menos capaces de pensar”.

Los expertos coinciden en que conocen cómo funciona una inteligencia artificial y entienden que es algo programado. “Necesitamos prepararnos más para que la gente esté más informada y entendemos que los agentes de IA pueden divertirse y tener parciales. La forma en que tengamos sistemas de IA tenderá a tener un gran efecto en la forma en que la gente responda a ellos”, dijo Maes.

Puedes seguir un EL PAÍS Tecnología fr. Facebook Sí X o haga clic aquí para recibir el nuestro boletín semanal.

Suscríbete para seguir el curso

Límites del pecado de Lee

_